文章信息

- 种衍文, 王泽文, 陈蓉, 王莹莹

- CHONG Yanwen, WANG Zewen, CHEN Rong, WANG Yingying

- 一种多特征自适应融合的粒子滤波红外目标跟踪方法

- A Particle Filter Infrared Target Tracking Method Based on Multi-feature Adaptive Fusion

- 武汉大学学报·信息科学版, 2016, 41(5): 598-604

- Geomatics and Information Science of Wuhan University, 2016, 41(5): 598-604

- http://dx.doi.org/10.13203/j.whugis20140185

-

文章历史

- 收稿日期: 2014-05-08

2. 杭州海康威视数字技术股份有限公司研究院, 浙江 杭州 , 310051

2. Research Institute of Hangzhou Hikvision Digital Technology Co., Ltd, Hangzhou 310051, China

红外运动目标跟踪一直是计算机视觉领域中的一个研究热点,也是红外精确制导、红外预警等算法中的一项核心技术。文献[1]提出了一种使用小波熵特征的红外图像序列的行人跟踪方法,这种方法对于背景复杂的情况往往会失效。文献[2]采用颜色特征对目标进行跟踪,这个算法对目标部分短暂被遮挡以及目标形状的微小形变具有鲁棒性,但是由于颜色特征对背景颜色变化很敏感,当跟踪目标在光照发生变化、被其他物体完全遮挡或者发生非平面旋转运动时,往往会丢失跟踪目标。文献[3]提出了基于Hausdorff距离的跟踪算法,该算法通过计算目标的形状信息来进行目标跟踪,对光照和具有相似颜色的跟踪目标具有较好的区分度,但当目标与背景或其他目标的轮廓具有相似性时,计算量很大且容易跟踪失败。因此,对于复杂环境下的目标跟踪,仅仅利用目标的单一特征的跟踪往往不具有鲁棒性。文献[4]提出了一种基于目标的颜色和边缘特征的融合算法,同时采用卡尔曼滤波算法快速预测下一时刻目标的运动轨迹,但物体的运行往往不是线性的;文献[5]提出了一种基于多特征融合的粒子滤波算法,该算法按一定的权值系数利用目标的颜色特征和边缘特征来构建似然函数作为目标的跟踪依据,这种算法的关键是赋予每种特征合适的权重,但是权重不能根据环境变化做到在线更新,背景复杂时跟踪往往会失效; 文献[6]提出了一种基于观测多样性和颗粒的空间散射性的特征组合,使用颜色、边缘和纹理特征进行加权,但是大量的特征会导致运算极其复杂,不适合于实时应用。

本文借助粒子滤波的天然框架构建多特征模型,并实现各特征权重的在线更新。

1 特征提取红外目标跟踪的难点主要在于可利用的特征较少。基于颜色特征的跟踪算法对有微型变形、平面旋转和尺度变化的非刚性物体具有良好的鲁棒性,广泛运用在检测、跟踪领域。四方向特征(four direction features,FDF)特征[7, 8]通常用于人脸检测,较少被运用于目标跟踪。Haar特征和方向梯度直方图(histogram of oriented gradient,HOG)特征[9]则已经广泛运用到行人检测中,特别是HOG特征,其计算了9个方向的特征信息,从而能够更全面地提取行人整体轮廓特征,但其计算复杂,FDF特征只需要计算4个方向的特征,在保证算法实时性上具有优势。

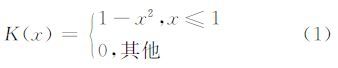

1.1 颜色直方图图像像素的值域是 RGB 颜色空间,按照直方图的方式将 RGB 颜色空间的每个R、G、B子空间分成k个相等的空间,每个空间称为一个bin,构成特征空间,特征空间中特征值的个数(即 bin的个数)为m=k3。本文选择加权直方图作为颜色模型,加权颜色直方图反映了目标区域的统计特征。核函数是Epanechnikov核函数:

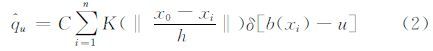

核函数具有权值减小缓慢的特征,这个特征能保证有更多的区域获得权值从而具有多样性,对于提高跟踪的稳定性十分有利。假设目标区域每个像素用{xi}(i=1,2,…,n)表示(n表示区域内的像素个数),目标特征u=1,2,…,m(u为图像像素的灰度级别)估计的概率密度为:

式中,C为归一化系数; 表示以x0为中心的直方图权值;xi表示候选区域内的任意一点;δ[]为单位冲激函数;b(xi)是坐标为xi的像素值所对应的第i个特征直方图的区间;

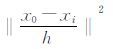

表示以x0为中心的直方图权值;xi表示候选区域内的任意一点;δ[]为单位冲激函数;b(xi)是坐标为xi的像素值所对应的第i个特征直方图的区间; 为求xi到x0的欧氏距离;h为带宽。

为求xi到x0的欧氏距离;h为带宽。

FDF特征是一种相对比较简单的特征,能够提取目标的轮廓特征,适合于行人目标的检测。FDF特征计算过程主要分为两个步骤。

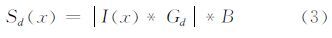

1) 利用梯度算子,计算4个方向的梯度,作为初级FDF特征;然后,对得到的初级FDF特征进行高斯模糊,平均化得到最终的FDF。初级FDF特征的计算公式为:

式中,Sd(x)是初级的FDF特征;I(x)是灰度图像(x是像素点);表示卷积运算;Gd是梯度算子,用来计算方向为d∈D,D={0°,45°,90°,135°} 的4个方向的梯度;B是2维高斯平滑滤波器,用来平滑不同行人样本的细节部分。

2) 对求得的初级FDF特征值,以M×N个大小为单位进行平均,作为此M×N个像素点的特征值,得到的4个方向的平均梯度值向量之和作为图像的最终FDF特征向量gd(x)。

2 多特征自适应融合根据不同特征对目标与背景的可分性,对融合特征中的各特征分量的权值根据背景变化进行自适应调节。对粒子滤波跟踪算法进行改进,利用动态空间模型[10]对粒子状态进行预测,增强跟踪的稳定性。

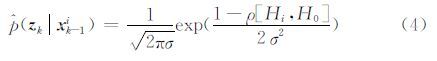

2.1 特征融合Bhattacharyya系数[11]定义了目标和候选目标之间的距离,其值越大表示两个分布之间的相似性越高。状态的似然函数与在当前状态下候选目标与参考目标的距离呈正相关,即候选目标与参考目标越相似,似然概率就越大[12],根据B氏系数计算粒子xki的候选模型Hi与目标模型H0之间的相似性:

当 最大时,目标模型与候选模型最相似。

最大时,目标模型与候选模型最相似。

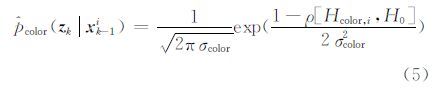

同理,根据目标与候选目标颜色特征的相似性,可以得到颜色特征似然函数:

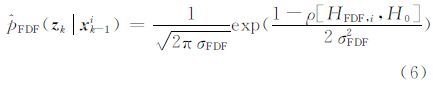

FDF特征似然函数为:

式中, 表示颜色似然函数;

表示颜色似然函数;

表示FDF特征似然函数;Hcolor,i表示各粒子颜色特征候选模型;HFDF,i表示各粒子FDF特征候选模型。

表示FDF特征似然函数;Hcolor,i表示各粒子颜色特征候选模型;HFDF,i表示各粒子FDF特征候选模型。

由式(5)和式(6)计算得到目标的颜色特征似然函数和FDF特征似然函数。

对于多目标优化问题,加权法是其中常见的一种方法[13]。对于一个有k个目标的最大化问题,可以表示为:

式中,x∈Rm为决策向量;y∈Rm为目标向量;fi(x),i=1,2,…,k是目标函数;wi(x)为系统约束。

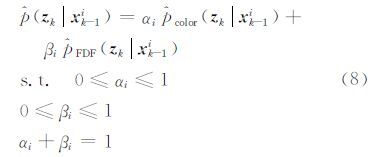

根据这一理论,设目标的联合似然函数为:

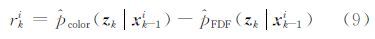

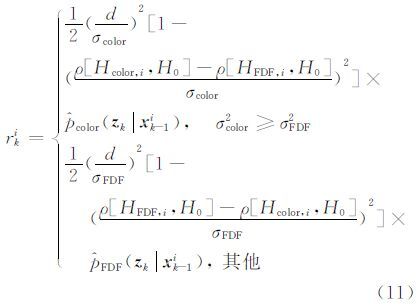

设k时刻所有粒子颜色特征与FDF特征似然函数之差为:

由式(5)和式(6)可知:

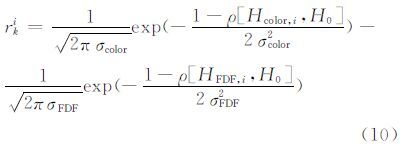

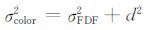

若σcolor2≥σFDF2,σcolor2可以表示为:

否则,σFDF2=σcolor2+d2

由二阶麦克劳林公式可知,当d很小时:

对于颜色似然函数和FDF似然函数,d是一个足够小的数,且:

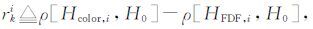

那么 (ε无穷小)是一个足够小的数,

(ε无穷小)是一个足够小的数, 表明粒子权重的变化依赖于特征模型之差的变化。所以,各粒子特征似然函数之差rki表征了环境的变化。

表明粒子权重的变化依赖于特征模型之差的变化。所以,各粒子特征似然函数之差rki表征了环境的变化。

权值变化归一化:

通过rki来调整各粒子联合特征中各特征分量的权重。

更新颜色特征权重:

更新FDF特征权重:

从而实现了联合似然函数中各特征分量的权重根据环境变化自适应更新,使得联合似然函数对当前目标具有更强的表征性。

2.3 粒子权重更新颜色权重αi和FDF权重βi的变化导致式(8)联合似然函数的变化。在粒子滤波中,各粒子的似然函数表示了该粒子的权重,也就是目标处于当前粒子所处位置的可能性的大小,目标联合似然函数的变化导致粒子权重的变化。

更新每个粒子的权重:

式中,ωk-1(i)表示粒子i在k-1时刻的权重;ωk(i)表示粒子i在当前时刻的权重; 表示粒子i在当前时刻的观测似然函数,即上文中的联合似然函数。

表示粒子i在当前时刻的观测似然函数,即上文中的联合似然函数。

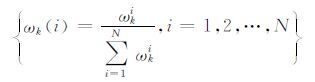

粒子权重归一化:

从而完成粒子权重的更新。联合概率似然函数 随着环境变化而变化,粒子权重也随之更新,使得粒子滤波运动目标跟踪更加稳定。

随着环境变化而变化,粒子权重也随之更新,使得粒子滤波运动目标跟踪更加稳定。

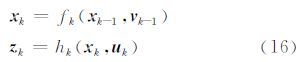

动态空间模型是一个重要的统计分析工具,用适当的模型来描述一个实际的物理算法,对于分析和解决问题十分重要。在物理学中,一般有一阶的匀速直线运动方程和二阶的加速度运动方程,并加入过程和量测噪声。粒子滤波的动态模型可表示为:

式中,xk为k时刻目标状态;zk为k时刻状态观测值;fk和hk为非线性函数;uk为过程噪声;vk为观测噪声,是相互独立不相关的两组噪声序列。

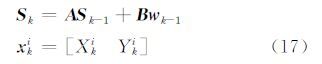

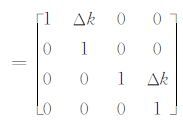

自回归过程是一种通过历史数据来预测目前状态的时间序列建模策略。本文采用的状态转移概率模型是一阶自回归模型,描述了从k-1时刻到k时刻的粒子的状态转移。算法动态模型为:

式中,Sk=[Xk X′k Yk Y′k],Sk表示目标在k时刻的状态,X′k、Y′k分别为Xk、Yk的一阶导数;A 表示状态转移矩阵;wk-1表示归一化噪声量;A、B是常数,可通过图像序列的学习得到。

表示状态转移矩阵;wk-1表示归一化噪声量;A、B是常数,可通过图像序列的学习得到。

根据动态空间模型,通过粒子的历史运动状态来预测目前粒子的状态:

从而保证粒子滤波跟踪算法在环境突变时不会立刻丢失跟踪目标,有助于增强跟踪的稳定性。

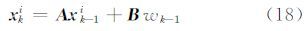

2.5 多特征自适应融合粒子滤波算法步骤步骤一 初始化k=0时刻粒子的权重

利用先验信息p(x0)初始化粒子状态分布{xki,i=1,2,3,…,N},并将每个粒子的初始权值赋为

步骤二 计算k=1时刻粒子的权重及状态

1) 重要性采样。利用式(18)传递xk-1i,得到新的粒子群{xki}。

2) 目标似然函数更新。利用式(5)和式(6)计算颜色特征和FDF特征的似然函数。由式(8)计算每个粒子状态对应的联合似函数,由式(13)(14)更新粒子的联合似然函数中各特征的权重,由式(15)更新粒子滤波框架中各粒子的权重。

3) 利用最小均方误差计算估计跟踪目标的状态。

4) 重采样。计算 ,如果Neff<NT(NT为定义的阈值),则进行重采样。

,如果Neff<NT(NT为定义的阈值),则进行重采样。

步骤三 k=k+1,重复第二步

2.6 算法可行性分析

本文算法从似然函数与粒子滤波中粒子权重之间的关系出发,构建以多特征似然函数加权和为目标联合似然函数的粒子滤波多特征融合框架。各粒子的特征似然函数服从高斯分布,而对于两个服从高斯分布的似然函数 和

和

,两者之差rki满足式(11)。

,两者之差rki满足式(11)。

根据跟踪过程中各特征似然函数的相对变化,赋予在跟踪过程中起主要作用的特征以更大的权重,量化环境变化对各个特征权重的影响,算法复杂度为O(i2),i为粒子个数。这克服了文献[4]的固定权重算法对复杂环境的适用,避免了文献[14]中采样点的个数对特征权重的影响。文献[15]与文献[16]通过融合特征似然函数的均值和方差实现了较好的跟踪效果,但算法复杂度较高,达到O(i4)。环境变化导致了特征似然函数的变化,利用各特征似然函数的变化评估环境的变化,反映了目标与环境的可分性,这是文献[17, 18]不具备的。

3 实验结果与分析为了证实本文方法的稳健性,对6视频序列进行了测试,测试视频来自OSU热步行数据库、Terravic运动红外线数据库和Audio-Visual Vehicle(AVV)数据库,包含各种异常情况。算法是基于VC和Matlab的混合编程,电脑配置为Intel Core i3-2120 CPU 3.3 GHz,内存4 GB。

3.1 多序列跟踪效果图 1从上至下每行分别为图像序列S1~S6,其中,序列S1~S4是从OSU热步行数据库获得的,S5是从Terravic运动红外线数据库获得的,S6是从AVV的数据集获得的,图像大小统一为240×320像素,感兴趣对象都是行人,跟踪系统中所有序列的参数相同。

|

| 图 1 跟踪效果 Fig. 1 Tracking Results |

从图 1所示的几种序列跟踪效果可以看出,本文方法对于遮挡、温度变化、背景干扰、其他运动目标干扰、快速运动、人体姿态变化等各种异常情况都具有良好的鲁棒性和稳定性。

3.2 与其他融合算法的性能比较除了直观地比较跟踪效果外,本文提出定量的相对位移错误率(displacement error rate,DER)指标来比较融合特征算法的跟踪效果,也就是跟踪目标的实际位置与算法计算的位置之差与实际位置的比值,其定义为:

式中,xc是目标的计算位置坐标;rc是目标的实际位置坐标。

DER越小,说明跟踪效果越好。

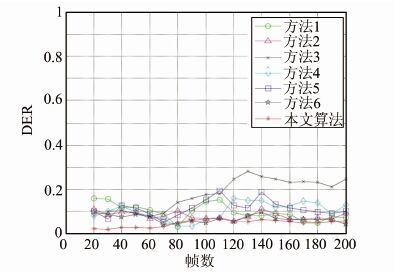

将本文算法与文献[3, 14, 15, 16, 17, 18]算法(分别记为方法1~6)进行比较。7种算法在Terravic运动红外线基准数据库图像序列S5的DER的测试结果见图 2。

|

| 图 2 本文算法与其他算法的DER比较 Fig. 2 Comparison of the DER Between Our Algorithm with Other Algorithms |

从图 2可以看出,几种当前先进的特征融合算法的DER值都在0~0.25之间波动。方法1是融合颜色特征和FDF特征卡尔曼滤波跟踪算法,方法2代表了固定权重融合颜色和FDF特征的粒子滤波跟踪算法,方法3以模糊方法实现特征融合,方法4以各特征分量的期望和方差构建联合似然函数,方法5是基于多目标优化进化算法实现特征融合,方法6是基于粒子群优化算法的融合策略。

由DER定义可知,模糊算法的DER值波动最大,而本文提出的基于特征似然函数的多特征自适应融合粒子滤波跟踪算法的DER值较小且波动平缓。这是因为本文提出的动态粒子滤波跟踪模型是根据环境变化自适应调整各特征的权重,更能适应复杂环境下的运动目标跟踪;而且本文使用的FDF特征只需计算4个方向的梯度,比需要计算9个方向的HOG特征计算量小,因此,在具有较高精度的跟踪性能时,能花费较少的时间计算边缘特征。

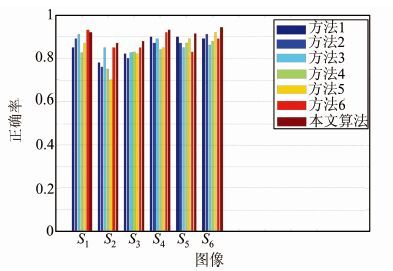

为了进一步评估本文算法与当前先进的特征融合方法的性能,以每个序列中正确跟踪帧数占总帧数的比重来各衡量各融合算法的跟踪性能[15]:

式中,Ferror表示序列中错误跟踪的帧数;Ftotal表示序列的总帧数。

文献[3, 14, 15, 16, 17, 18]的特征融合算法与本文方法对6个测试序列S1~S6进行测试,测试结果如图 3所示。

|

| 图 3 各跟踪算法正确率 Fig. 3 Accuracy of Each Tracking Algorithm in Those Sequences |

考虑到粒子滤波是一种概率算法,每次实验结果都会有差异,所以每个实验运行12次,取结果的平均数。从图 3可以看出,本文特征融合方法跟踪错误少于其他跟踪方法,跟踪准确率更高。在大多数跟踪序列中,方法4和方法5出现跟踪不良结果的概率大,方法6的跟踪误差虽然与本文算法比较接近,但本文方法具有最小的跟踪误差。

4 结 语本文根据红外图像的特点,选取具有弱相关性、强互补性的颜色特征及边缘特征,借助粒子滤波的天然框架,分别构建了颜色特征似然函数和FDF边缘特征似然函数,提出了粒子滤波动态模型,根据环境变化赋予两种特征不同的权重。在背景和目标颜色相近时,颜色特征对目标的识别不敏感,利用边缘特征进行有效的补充;在目标变形、遮挡情况下边缘特征无法稳定跟踪,利用颜色特征进行改进。实验结果表明,本文算法可以准确地实现目标跟踪,在环境不断变化、目标产生遮挡以及相似目标干扰的情况下,仍然可以进行有效的跟踪。在本文的基础上,可以考虑融合更多的特征进行目标建模,在粒子滤波权值更新步骤中引入多特征建模,有望进一步提高本文跟踪算法的性能。

| [1] | Li Jianfu,Wang Yang. Pedestrian Tracking in Infrared Image Sequences using Wavelet Entropy Features[C].IEEE Second Asia-Pacific Conference on Computational Intelligence and Industrial Applications, Wuhan, 2009 |

| [2] | van Koller N. An Adaptive Color-Based Particle Filter[J].Image and Vision Computing, 2012, 21(1):99-110 |

| [3] | Vignon D, Lovell B C, Andrews R J. General Purpose Real-Time Object Tracking Using Hausdorff Transforms[C]. The 9th International Conference on IPMU, Annency, France, 2012 |

| [4] | Liu Jin. Research and Implementation Based on Multi-feature Fusion Particle Filter Algorithm[J].Computer Measurement & Control, 2013, 11(5):1307-1309 |

| [5] | Chen Shanjing. Study of Particle Filtering Algorithm Based on Multi-feature Fusion[J].Computer Engineering,2011, 37(7):179-180 |

| [6] | Komeili M, Armanfard N, Kabir E. A Fuzzy Approach for Multi-feature Pedestrian Tracking with Particle Filter[J].IEEE International Symposium on Telecommunications, 2008,2(8):570-576 |

| [7] | Yao Haitao, Zhu Fuxi, Chen Haiqiang. Face Tracking Based on Adaptive PSO Particle Filter[J].Geomatics and Information Science of Wuhan University,2012, 37(4):493-497(姚海涛,朱福喜,陈海强.一种自适应的PSO粒子滤波人脸视频跟踪方法[J].武汉大学学报·信息科学版,2012,37(4):493-497) |

| [8] | Iwata K, Hongo H, Yamamoto K, et al. Robust Facial Parts Detection by Using Four Directional Features and Relaxation Matching[J]. IEEJ Transactions on Electronics Information and Systems,2004, 124(3):706-712 |

| [9] | Erdema E, Dubuissonb S, Blochc I.Visual Tracking by Fusing Multiple Cues with Context-Sensitive Reliabilities[J].Pattern Recognition, 2012, 45(5):1948-1959 |

| [10] | Hiratsuka M. Pedestrian Detection for a Near Infrared Imaging System[C]. The 11th International IEEE Conference on Intelligent Transportation Systems, Beijing, 2008 |

| [11] | Chen S Y. Kalman Filter for Robot Vision:A Survey[J]. IEEE Transactions on Industrial Electronics, 2011, 99:1-2 |

| [12] | Wang Shupeng, Ji Hongbing. Based Target Tracking Method Color Space Model[J].Xi'an Electronic Science and Technology Report, 2009, 34(4):77-78 |

| [13] | Jia Yonghong, Li Deren. An Approach of Classification Based on Pixel Level and Decision Level Fusion of Multi-source Images in Remote Sensing[J].Geomatics and Information Science of Wuhan University,2001,26(5),431-433(贾永红,李德仁.多源遥感影像像素级融合分类与决策级分类融合法的研究[J].武汉大学学报·信息科学版,2001,26(5):431-433) |

| [14] | Wang Huan,Wang Jiangtao,Ren Mingwu,et al.A Robust Multi-feature Fusion Target Tracking Algorithm[J].Chinese Journal of Image and Graphics, 2011,14(3):489-498(王欢, 王江涛, 任明武, 等.一种鲁棒的多特征融合目标跟踪新算法[J].中国图象图形学报, 2011, 14(3):489-498) |

| [15] | Komeili M, Armanfard N,Kabir E.A Fuzzy Approach for Multi-feature pedestrian tracking with particle filter[C]. Internatioal Symposium on Telecommunications, Tehran, Iran, 2012 |

| [16] | Fen Xu,Zhao Lijuan.A Particle Filter Tracking Algorithm Based on Adaptive Feature Fusion Strategy[J].Intelligent Control and Automation,2012,8(12):4612-4615 |

| [17] | Quadtrees M T. A Data Structure for Restoring Pare to Sets in Multi-object Evolutionary Algorithms with Elitism[M]. New York:Springer Verlag, 2005 |

| [18] | Parsopoulos K E,Vrahati M N. Particle Swarm Optimizer in Noisy and Continuously Changing Environments[M]//Hamza M H. Intelligence and Soft Computing, Anaheim, CA:ACTA Press, 2001 |

2016, Vol. 41

2016, Vol. 41