文章信息

- 龚健雅, 崔婷婷, 单杰, 季顺平, 黄玉春

- GONG Jianya, CUI Tingting, SHAN Jie, JI Shunping, HUANG Yuchun

- 利用车载移动测量数据的建筑物立面建模方法

- A Survey on Facade Modeling Using LiDAR Point Clouds and Image Sequences Collected by Mobile Mapping Systems

- 武汉大学学报·信息科学版, 2015, 40(9): 1137-1143

- Geomatics and Information Science of Wuhan University, 2015, 40(9): 1137-1143

- http://dx.doi.org/10.13203/j.whugis20150173

-

文章历史

- 收稿日期:2015-03-27

2. 武汉大学测绘遥感信息工程国家重点实验室, 湖北 武汉, 430079;

3. 地球空间信息技术协同创新中心, 湖北 武汉, 430079;

4. 普度大学土木工程学院, 美国拉斐特, 47907

2. State Key Laboratory of Information Engineering in Surveying, Mapping and Remote Sensing, Wuhan University, Wuhan 430079, China;

3. Collaborative Innovation Center of Geospatial Technology, Wuhan 430079, China;

4. School of Civil Engineering, Purdue University, West Lafayette, IN 47907, USA

随着传统光学成像及激光扫描等传感器技术的发展,三维空间数据获取的能力大大提高。同时,人们对空间信息的需求也渐渐从二维扩展到三维,其中,城市地区的三维重建是一个持续的研究热点。显而易见,立面是建筑物的主要组成部分。虽然近年来发展迅速的多视航空遥感技术具有快速获取大规模城市三维模型的能力,但鸟瞰式的视角难以完整获取建筑物立面信息。而车载移动测量系统恰好可在街景级别的分辨率上高效采集道路两侧建筑物丰富和直观的立面信息,是航空遥感数据的必要补充,近年来得到了各科研院所、测绘机构及互联网公司的关注,成为数字城市建设重要的空间数据源之一。

目前,车载移动测量软硬件发展失衡,缺乏成熟的自动化处理流程及标准,数据处理能力难以与数据采集能力匹配。现有移动测量系统所采集的海量三维点云和影像序列,多局限于街景地图的在线展示。事实上,移动测量数据在三维场景重建方面有巨大潜力,有能力实现高质量建筑物立面模型的自动化生产。

本文在分析车载移动测量数据的特点及常见问题的基础上,对国内外以建立建筑物立面模型为目标的研究进行总结,并将算法分为重建和增强两大类进行讨论。其中,重建侧重于由数据到现实世界的恢复过程,是数据获取(由现实世界到二维或三维坐标系的映射及采样)的逆过程,重建得到的模型质量与数据质量相关。而增强则侧重于对模型的改善,包括模型的细化、补充与规则化,与重建过比,该过程运用知识实现对模型质量的提高。最后,本文归纳了现有方法的主要不足及存在的挑战。

1 车载移动测量数据 1.1 数据的特点车载移动测量系统采集的主要数据类型为三维点云和影像序列,两者各有特点,其中点云的特点为:① 直接获取的被测物表面的三维坐标;② 空间分辨率较低;③ 有效测量距离有限。而影像序列的特点为:① 具有丰富、直观的纹理信息;② 分辨率更高,边缘特征更精确;③ 视场角较大,其中全景相机更是达到360°。如何结合两者的优势、实现高度自动化的建筑物立面三维重建,具有较高的理论研究和应用价值。

1.2 数据存在的问题使用车载移动测量系统采集的三维点云和影像序列数据,存在以下常见的问题。

首先,点云和影像的配准。车载移动测量系统得到的点云数据和影像数据常常不能准确对齐,影响纹理映射和数据融合的效果。原因包括:①车载移动测量系统两类传感器的检校误差;②异源数据获取时间的差异——点云是一段时间的积累,而影像是某一时刻的瞬间拍摄结果。在参考信息(如GPS/IMU)不准时,配准误差尤为显著。

其次,遮挡问题。建筑物立面受到树木、电线杆、车辆、行人等前景的遮挡,导致被遮挡区域的数据缺失。该现象在点云和影像中都会独立存在,在线阵激光扫描获取的点云数据中尤为严重。

第三,点云数据缺失。由于激光有效测量距离有限、对玻璃等透明介质有穿透性、金属等高反射强度对象的回波强度超过接收范围等原因,造成相应区域点云缺失。

最后,纹理图像位移和色差问题。由于外方位元素的误差和相机镜头畸变等,相邻影像的纹理拼接会出现几何上的偏差;同时,光照差异也会导致色调的差异。

2 建筑物立面重建基于车载激光点云和影像数据的建筑物立面重建的基本步骤为点云数据获取、建筑物点云识别、几何模型重建及纹理映射。

2.1 三维点云生成若使用影像序列进行建筑物立面三维重建,首先要恢复像点的三维信息——一个摄影测量和计算机视觉[1, 2]的经典问题。影像序列可分为三大类:① 立体相对[3];② 普通影像序列[4];③ 全景影像序列[5, 6]。随着全景相机被广泛应用于街景地图,采用全景影像进行三维重建的方法值得关注。无论采用何种影像数据源,基于影像序列进行三维重建均涉及到影像匹配,而影像匹配是个歧义问题,由此得到的点云可靠性一般低于激光扫描直接测得的点云。

激光扫描技术可以直接获取被测物表面的三维坐标。结合点云和影像进行建筑物立面的重建,早期的工作可以追溯到2005年,文献[7]使用装载了线阵激光扫描仪和数码相机的移动测量车,建立了带纹理的建筑物立面格网模型。随着成本降低,更多的车载移动测量系统配置了激光扫描仪,并将其作为获取三维信息的主要途径。同时,使用激光点云结合影像进行建筑物立面重建也受到了更多研究者的关注[8, 9, 10]。

2.2 建筑物点云识别三维点云包含场景中的多种地物,如地面、建筑物、车辆、电线杆、树木、车辆、行人等,点云的分类或识别是进行建筑物三维重建的基础工作。

建筑物点云识别方法可分为4类:① 基于平面约束的方法[11]简单直观、便于实现,但漏检和误检概率高;② 基于知识的方法[8]使用区域增长分割点云,其中邻域的定义很关键[12],该方法相对精确,但效率较低;③ 基于二维空间分布的方法依赖于投影点密度[13, 14]、高度、空间特征值[15]等特征量,效率高但受阈值影响大;④ 基于学习的方法[16]往往能达到较高的准确率,但需要手工标记样本。总之,点云分类研究有两个发展趋势:一是基于机器学习的方法,目标是提高识别准确率;二是在线识别,致力于提高效率。

目前,城市地区的点云分类仍是研究热点。2014年,欧盟IQmulus项目组和法国TerraMobilita项目组联合举办了点云分类竞赛[17],该竞赛定义了城市地区对象的类别,并提供了相关点云数据、标注数据及明确的结果评估方法,对点云分类研究有指导意义。

2.3 几何模型重建检测出建筑物的点云后,根据预定义的目标模型进行重建。其中,细节程度和模型结构是目标模型的两个关键参数。

结合车载激光的数据获取能力,本文将建筑物立面模型的细节程度按照CityGML 建筑物的细节层次(level of detail,LOD)标准<sup>[18]进行定义。具体参数见表 1。

| 等级 | LOD1 | LOD2 | LOD3 |

| 应用场景 | 城市级别 | 街景级别 | 建筑物级别 |

| 细节程度 | 粗略模型 | 单个建筑 | 建筑物立面细节 |

| 精度要求(位置/高度) | 5 m /5 m | 2 m/2 m | 0.5 m / 0.5 m |

| 简化程度(面积/长度) | 对象包围盒 > 6 m×6 m/3 m | 包含基本特征的对象 > 4 m×4 m/2 m | 包含细节特征的对象 > 2 m×2 m/1 m |

| 建筑物辅助部件 | 无 | 有 | 明显特征 |

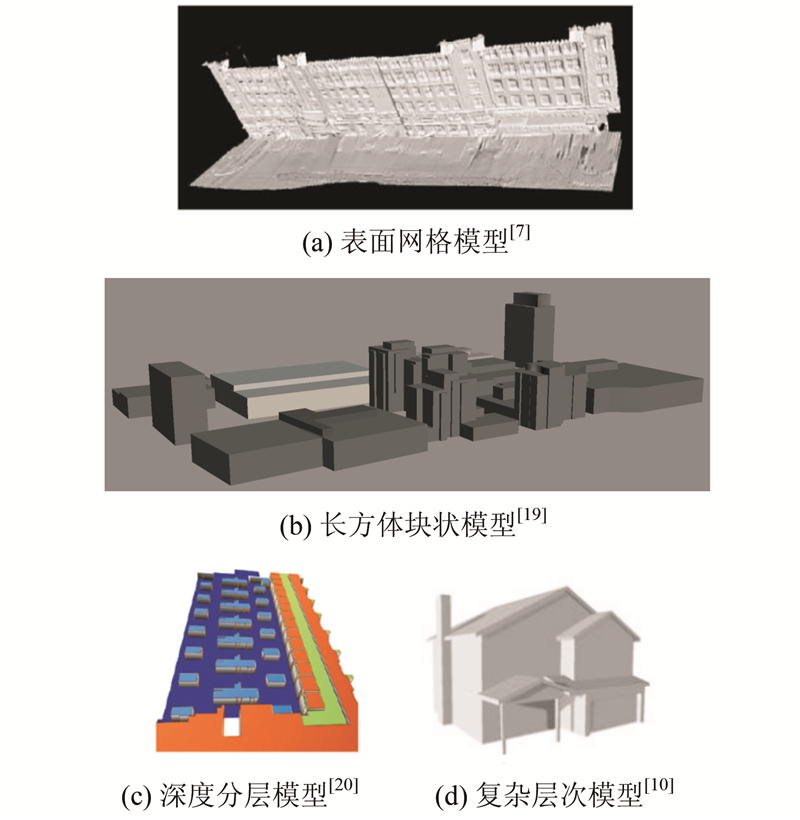

常用的模型结构包括:① 表面网格模型,用三角网或格网来表示建筑物立面及城市场景[7],适用于小范围的模型渲染,但数据量大且缺乏对象的语义信息;② 长方体块状模型或长方形表面模型,前者针对街区的建筑物整体模型[19],后者是针对建筑物立面的简化模型[15],适用于大规模场景的LOD1级别的粗略建筑物立面快速重建,但缺乏细节描述;③ 深度分层模型[4, 20]或细胞剖分模型[21],将建筑物立面近似为平面,根据规则化的边缘对平面进行剖分,并赋予不同的深度信息,适用于LOD2-3级别包含建筑物立面细节的单个建筑物立面重建,其局限性是对于半圆形、三角形等不规则对象的描述能力差;④ 基于多边形[22]或多面体[10]的复杂层次模型,该模型以语义信息为基础,用层次模型来组织建筑物对象,并约束了拓扑关系,适用于LOD2-3级别的完整模型。不同模型的实例如图 1所示。

|

| 图 1 常见建筑物立面模型示例 Fig. 1 Examples of Facade Models |

纹理映射是从二维图像到三维模型表面的映射,从而得到近似于真实场景的物体表面,是建立具有真实感三维模型必不可少的步骤。

基于车载影像序列的纹理映射包含4个主要步骤:① 计算三维模型在影像上的纹理坐标[23, 24]。其中影像与点云的配准是基础,线特征[25]和互信息[9]是常用的配准依据。② 最优纹理区域的选择。对于模型的各个多边形表面,在影像序列中选取最优的影像及区域,两个关键要求是距离近和遮挡少。③遮挡的去除。通过最优影像区域的选择可以在一定程度上避免树木、电线杆等静态目标的遮挡,但行人、车辆等动态物体及遮挡物与建筑物立面过近等情况仍需依赖基于图像的遮挡检测、去除及纹理恢复算法[26, 27]。④影像的拼接与匀光。来自不同影像的区域会出现无法对齐及分辨率、色调不一致的情况,拼接和匀光后才能生成无接缝的纹理[28, 29]。

总体而言,纹理映射是影响建筑物模型效果的关键因素,厘米级的误差都可能导致边缘的巨大色差对比;目前纹理映射的自动化程度较低,仍是制约自动化重建的关键因素之一。

3 建筑物立面增强由以上步骤重建得到的建筑物立面模型质量受数据质量的影响,利用影像中丰富的几何信息和建筑物设计中包含的规则可进一步提高模型质量,实现建筑物立面的增强。建筑物立面增强包括用影像对立面模型进行补充与细化,及利用建筑物设计中的基本模式和高级语法的增强对门、窗等建筑物细节的规则化。

3.1 基于影像的增强影像对几何信息的增强主要体现在完整性上对数据的补充和精确性上对模型的细化两方面。

在完整性上,影像可弥补激光有效距离有限、遮挡、穿透性等原因造成的点云缺失。例如,使用影像弥补点云无法获取的较高建筑物顶部数据[20],弥补窗户区域玻璃等透明介质造成的三维数据缺失[9],对于遮挡等原因造成的数据缺失,通过不同位置获取的影像序列可恢复被遮挡区域的三维坐标。此外,利用基本规则也可实现缺失区域的修补(详见§3.2)。

在精确性上,影像分辨率高于点云,所检测的边缘、角点等特征更加精确,可增强立面边缘信息的准确性,尤其是在线特征集中的建筑物外轮廓[30]和窗户区域[31]。

总之,影像对增强点云几何信息的有效性已得到初步证实,更高级别的特征、语义融合仍有待进一步研究。

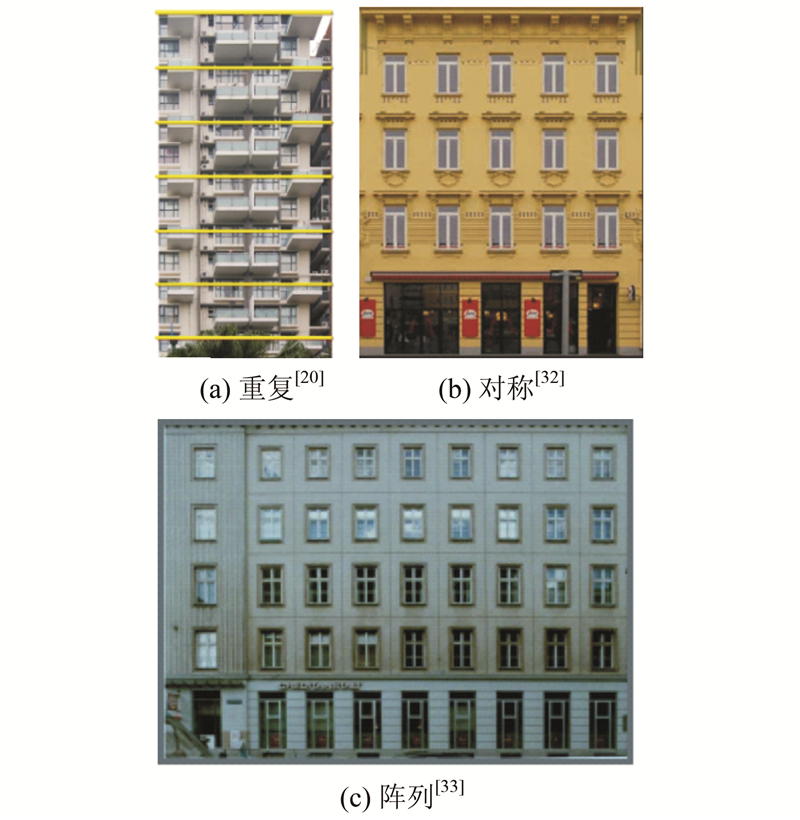

3.2 基于模式规则的增强基本模式规则是指人工地物中常常出现的重复、对称、阵列等现象。其中,重复是相同(或相似)对象在一维空间中的反复出现,如高层建筑物的楼层(图 2(a));对称则是局部或者全局沿某个轴左右相同的现象,如建筑物的门、窗,如图 2(b);阵列是指相同对象在二维空间中规律出现,如图 2(c),阵列也可看作重复和对称现象的综合。规则一方面可以作为检测这些对象的依据,另一方面也可用于增强数据及改善检测结果。

|

| 图 2 建筑物立面常见的基本规则 Fig. 2 Common Patterns of Facade |

基本规则的检测方法及相关应用按照以下4种类别进行阐述。① 基于扫描线的密集型检测方法[34, 35, 36]是指沿主方向进行扫描并计算扫描线两侧特征量的变化率,其局部极值点则对应重复出现的关键位置,该方法常用于窗户检测。② 特征空间聚类的稀疏型检测法[32, 37, 38, 39, 40]将特定规则定义为转换,用转换的关键变量构建新的特征空间,两两选取特征点计算其相似度并在特征空间中累加,最后在特征空间中寻找极值点反投至空间坐标得到规则。稀疏型和密集型两种方法结合可提高检测的效率和准确率[41]。③ 基于马尔科夫随机场的方法[42]以备选结构为结点,使用拓扑关系和形状约束结点间的相互关系,并找出符合最大后验概率规则的阵列。该方法适用于检测阵列规则,还可用于推测被遮挡结构的位置。④ 基于机器学习的方法[43, 44]将机器学习的思想引入特定对象的检测,该方法需要大量标记样本,并选取恰当的特征训练分类器,常用于图像中的门、窗阳台等特定类别的建筑物细节检测。

3.3 基于高级语法规则的增强高级规则是基于规则的规则,由若干简单规则组成,还包含对象的语义信息、拓扑关系、包含关系等。高级规则的定义方法包括:① 基于语义层次细分的方法[33]将建筑物立面首先水平分为楼层,楼层中根据窗户的位置竖直分为单元,在单元中逐渐细分最终逼近门、窗等细节特征的边缘;② 形式语法描述的方法[36]使用四元组来表达语法规则G=Γ(N,T,P,ω),门、窗建筑物立面元素和基本规则等抽象元素为终端符号T,可由若干T替代的符号为非终端符号N,T和N共同构成语法的词汇,P为规则的集合,ω为起始符,由以上元素组合构建多层次树状结构的高级语法规则。

高级规则是城市建筑风格的反映,在同一区域内具有指导意义。文献[36]结合以上两种规则,将点云和影像数据估计规则应用在同一地区整个城镇的三维模型上,得到相同风格的建筑物立面模型结果。

4 结 语车载移动测量系统是建筑物立面数据采集的有效途径,使用车载移动测量数据进行建筑物重建已成为研究热点。综合目前已有的探索性研究,笔者归纳为尚存在以下几个挑战性问题:①自动化程度有限,大部分自动化重建的方法仅以简单的表面模型为建模目标而不考虑对象的语义信息,其主要瓶颈在于自动化的立面目标识别和纹理映射。②面向不同模型质量和尺度的细节多层次建筑物立面模型仍缺乏定义标准,难以与现有建筑物模型进行融合,给大规模生产应用造成障碍。③更高级别的点云和影像配准融合算法仍然空缺,目前算法多局限于从两种数据源中分别提取特征后进行融合,造成潜在信息损失。若在数据处理前期将两者使用一致、标准的数据结构组织起来,能够为后期的特征提取保留更多信息。此外,最高层次的语义级融合也是需要研究的方向之一;④现有规则检测及应用算法针对性过强,依赖于特定的前提,更具普适性的规则检测方法需要进一步研究。

虽然车载移动测量系统可以高效、快捷地获取建筑物立面信息,但是其数据获取方式也有局限性,它只能采集道路两旁的建筑物立面数据,建筑物背面及无法驶入车辆的区域无法获得数据。因此,如何与其他数据源结合,也是利用车载移动测量数据进行建筑物重建的挑战之一。机载或无人机可以快速获取大规模城市区域的数据,鸟瞰视角尤其是侧视视角[45]可以对建筑物模型的完整性进行有效的补充;由手机或普通数码相机拍摄的具有地理坐标的众源影像[46],也可为车载移动测量数据提供灵活、及时的补充。

| [1] | Forsyth D A, Ponce J. Computer Vision: A Modern Approach[M]. Upper Saddle River: Pearson Education, Inc., 2012 |

| [2] | Szeliski R. Computer Vision: Algorithms and Applications[M]. New York: Springer-Verlag, 2010 |

| [3] | Pollefeys M, Nistér D, Frahm J M, et al. Detailed Real-Time Urban 3D Reconstruction from Video[J]. International Journal of Computer Vision, 2008, 78(2): 143-167 |

| [4] | Xiao J. Image-Based Building Modeling[D]. Hong Kong: The Hong Kong University of Science and Technology, 2009 |

| [5] | Torii A, Havlena M, Pajdla T. From Google Street View to 3D City Models[C]. The 12th International Conference of the Computer Vision Workshops, Kyoto, 2009 |

| [6] | Micusik B, Kosecka J. Piecewise Planar City 3D Modeling from Street View Panoramic Sequences[C]. IEEE Computer Society Conference on Computer Vision and Pattern Recognition, Miami, FL, USA, 2009 |

| [7] | Frueh C, Jain S, Zakhor A. Data Processing Algorithms for Generating Textured 3D Building Facade Meshes from Laser Scans and Camera Images[J]. International Journal of Computer Vision, 2005, 61(2): 159-184 |

| [8] | Pu S. Knowledge Based Building Facade Reconstruction from Laser Point Clouds and Images[D]. Enschede, the Netherlands: University of Twente, 2010 |

| [9] | Wang R. Towards Urban 3D Modeling Using Mobile LiDAR and Images[D]. Montreal, Canada: McGill University, 2011 |

| [10] | Lin H, Gao J, Zhou Y, et al. Semantic Decomposition and Reconstruction of Residential Scenes from LiDAR Data[J]. ACM Transactions on Graphics, 2013, 32(4): 1-10 |

| [11] | Arachchige N H, Perera S N, Maas H G. Automatic Processing of Mobile Laser Scanner Point Clouds for Building Facade Detection[C]. The 22nd Congress of the International Society for Photogrammetry and Remote Sensing, Melbourne, Australia, 2012 |

| [12] | Yang Bisheng, Dong Zhen, Wei Zheng, et al. Extracting Complex Building Facades from Mobile Laser Scanning Data[J]. Acta Geodaetica et Cartographica Sinica, 2013, 42(3): 411-417(杨必胜,董震,魏征,等.从车载激光扫描数据中提取复杂建筑物立面的方法[J].测绘学报,2013,42(3):411-417) |

| [13] | Shi Wenzhong, Li Bijun, Li Qingquan. A Method for Segmentation of Range Image Captured by Vehicle-Borne Laser Scanning Based on the Density of Projected Points[J]. Acta Geodaetica et Cartographica Sinica, 2005, 34(2): 95-100(史文中, 李必军, 李清泉. 基于投影点密度的车载激光扫描距离图像分割方法[J]. 测绘学报, 2005,34(2):95-100) |

| [14] | Lu Xiushan, Huang Lei. Grid Method on Building Information Extraction Using Laser Scanning Data[J]. Geomatics and Information Science of Wuhan University, 2007, 32(10): 852-855(卢秀山,黄磊. 基于激光扫描数据的建筑物信息格网化提取方法[J]. 武汉大学学报·信息科学版, 2007, 32(10): 852-855) |

| [15] | Wei Zheng, Dong Zhen, Li Qingquan, et al. Automated Extraction of Building Facade Footprints from Mobile LiDAR Point Clouds[J]. Geomatics and Information Science of Wuhan University, 2012, 37(11): 1 311-1 315(魏征,董震,李清泉,等. 车载LiDAR点云中建筑物立面位置边界的自动提取[J]. 武汉大学学报·信息科学版, 2012, 37(11): 1 311-1 315) |

| [16] | Zhang C, Wang L, Yang R. Semantic Segmentation of Urban Scenes Using Dense Depth Maps[C]. The 11th European Conference on Computer Vision, Crete, Greece, 2010 |

| [17] | IQmulus, TerraMobilita. IQmulus & TerraMobilita Contest: Analysis of Mobile Laser Scans (MLS) in Dense Urban Environments[EB/OL]. http://data.ign.fr/benchmarks/UrbanAnalysis/, 2014 |

| [18] | Gröger G, Kolbe T H, Czerwinski A, et al. OGC City Geography Markup Language (Citygml) Encoding Standard v2.0[EB/OL]. http://www.opengeospatial.org/standards/citygml/, 2012 |

| [19] | Zhu L L, Hyyppa J, Kukko A, et al. Photorealistic Building Reconstruction from Mobile Laser Scanning Data[J]. Remote Sensing, 2011, 3(7): 1 406-1 426 |

| [20] | Li Y, Zheng Q, Sharf A, et al. 2D-3D Fusion for Layer Decomposition of Urban Facades[C]. The 13th International Conference of the Computer Vision, Barcelona, Spain, 2011 |

| [21] | Becker S, Haala N. Combined Feature Extraction for Facade Reconstruction[C]. ISPRS Workshop on Laser Scanningand SilviLaser, Espoo, Finland, 2007 |

| [22] | Pu S, Vosselman G. Knowledge Based Reconstruction of Building Models from Terrestrial Laser Scanning Data[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2009, 64(6): 575-584 |

| [23] | Wu Jun. Research on Rapidly Reconstructing Texture for Facades in 3D City Modeling[J]. Acta Geodaetica et Cartographica Sinica, 2005, 34(4): 317-323 (吴军. 3维城市建模中的建筑墙面纹理快速重建研究[J]. 测绘学报, 2005,34(4):317-323) |

| [24] | Fan Chong, Wang Xue. Research on Rapidly Reconstructing Texture for Facades in 3D City Modeling[J]. Geomatics & Spatial Information Technology, 2014, 37(7): 1-4 (范冲, 王学. 三维城市建筑物的纹理映射综述[J]. 测绘与空间地理信息, 2014, 37(7): 1-4) |

| [25] | Liu L, Stamos I. A Systematic Approach for 2D-Image to 3D-Range Registration in Urban Environments[J]. Computer Vision and Image Understanding, 2012, 116(1): 25-37 |

| [26] | Liu Yawen, Guan Zhen. Occlusion Removal for Building Facade Texturing[J]. Geomatics and Information Science of Wuhan University, 2010, 35(12): 1 457-1 460 (刘亚文, 关振. 街景建筑物立面纹理遮挡恢复方法研究[J]. 武汉大学学报·信息科学版, 2010, 35(12): 1 457-1 460) |

| [27] | Korah T, Rasmussen C. Analysis of Building Textures for Reconstructing Partially Occluded Facades[C]. The 10th European Conference on Computer Vision, Marseille, France, 2008 |

| [28] | Kang Z, Zhang L, Zlatanova S, et al. An Automatic Mosaicking Method for Building Facade Texture Mapping Using a Monocular Close-Range Image Sequence[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2010, 65(3): 282-293 |

| [29] | Kang Zhizhong, Zhang Zuxun, Zhang Jianqing. Rapidly Realizing 3D Visualization for Street Sight in Cyber City[J]. Geomatics and Information Science of Wuhan University, 2010, 35(2): 205-208 (康志忠,张祖勋,张剑清. 城市街道景观三维可视化的快速实现[J]. 武汉大学学报·信息科学版, 2010, 35(2): 205-208) |

| [30] | Kang Zhizhong, Wang Weiwei, Li Zhen. An Integrative Method of 3D Point Clouds Feature Segmentation and Fitting Fusing Multiple Data Sources[J]. Geomatics and Information Science of Wuhan University, 2013, 38(11): 1 317-1 321 (康志忠, 王薇薇, 李珍. 多源数据融合的三维点云特征面分割和拟合一体化方法[J]. 武汉大学学报·信息科学版, 2013, 38(11): 1 317-1 321) |

| [31] | Becker S, Haala N. Refinement of Building Facades by Integrated Processing of LiDAR and Image Data[C]. Photogrammetric Image Analysis, Munich, Germany, 2007 |

| [32] | Musialski P, Wonka P, Recheis M, et al. Symmetry-Based Facade Repair[C]. Vision, Modeling, and Visualization Workshop, Braunschweig, Germany, 2009 |

| [33] | Müller P, Zeng G, Wonka P, et al. Image-Based Procedural Modeling of Facades[J]. ACM Transactions on Graphics, 2007, 26(3): 85-94 |

| [34] | Friedman S, Stamos I. Online Facade Reconstruction from Dominant Frequencies in Structured Point Clouds[C]. IEEE Computer Society Conference on Computer Vision and Pattern Recognition Workshops, Providence, RI, USA, 2012 |

| [35] | Wang R, Ferrie F P, Macfarlane J. A Method for Detecting Windows from Mobile LiDAR Data[J]. Photogrammetric Engineering & Remote Sensing, 2012, 78(11): 1 129-1 140 |

| [36] | Becker S. Generation and Application of Rules for Quality Dependent Facade Reconstruction[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2009, 64(6): 640-653 |

| [37] | Wenzel S, Drauschke M, Fcrstner W. Detection of Repeated Structures in Facade Images[J]. Pattern Recognition and Image Analysis, 2008, 18(3): 406-411 |

| [38] | Zheng Q, Sharf A, Wan G, et al. Non-local Scan Consolidation for 3D Urban Scenes[C]. ACM SIGGRAPH 2010, Los Angeles, California, 2010 |

| [39] | Mitra N J, Guibas L J, Pauly M. Partial and Approximate Symmetry Detection for 3D Geometry[J]. ACM Transactions on Graphics, 2006, 25(3): 560-568 |

| [40] | Pauly M, Mitra N J, Wallner J, et al. Discovering Structural Regularity in 3D Geometry[J]. ACM Transactions on Graphics, 2008, 27(3): 1-11 |

| [41] | Wu C, Frahm J-M, Pollefeys M. Detecting Large Repetitive Structures with Salient Boundaries[C]. The 11th European Conference on Computer Vision, Crete, Greece, 2010 |

| [42] | Korah T, Rasmussen C. 2D Lattice Extraction from Structured Environments[C]. The 14th IEEE International Conference on Image Processing, San Antonio, Texas, USA, 2007 |

| [43] | Ali H, Seifert C, Jindal N, et al. Window Detection in Facades[C]. The 14th International Conference on Image Analysis and Processing, Modena, Italy, 2007 |

| [44] | Drauschke M, Fcrstner W. Selecting Appropriate Features for Detecting Buildings and Building Parts[C]. The 21st Congress of the International Society for Photogrammetry and Remote Sensing, Beijing, China, 2008 |

| [45] | Li Deren, Liu Likun, Shao Zhenfeng. An Integration of Aerial Oblique Photogrammetry and Mobile Mapping System for Urban Geographical Conditions Monitoring[J]. Geomatics and Information Science of Wuhan University, 2015, 40(4): 427-435 (李德仁, 刘立坤, 邵振峰. 集成倾斜航空摄影测量和地面移动测量技术的城市环境监测[J]. 武汉大学学报·信息科学版, 2015, 40(4): 427-435) |

| [46] | Shan Jie, Qin Kun, Huang Changqing, et al. Methods of Crowd Sourcing Geographic Data Processing and Analysis[J]. Geomatics and Information Science of Wuhan University, 2014, 39(4): 390-396 (单杰, 秦昆, 黄长青, 等. 众源地理数据处理与分析方法探讨[J]. 武汉大学学报·信息科学版, 2014, 39(4): 390-396) |

2015, Vol. 40

2015, Vol. 40