文章信息

- 许雪梅, 周立超, 杨兵初, 李梦平, 李丽娴, 尹林子, 丁一鹏

- XU Xuemei, ZHOU Lichao, YANG Bingchu, LI Mengping, LI Lixian, YIN Linzi, DING Yipeng

- CIFO:针对显著对象的彩色图像检索方法

- CIFO:A Retrieval Method for Color Images with Salient Object

- 武汉大学学报·信息科学版, 2015, 40(1): 53-58

- Geomatics and Information Science of Wuhan University, 2015, 40(1): 53-58

- http://dx.doi.org/10.13203/j.whugis20130195

-

文章历史

- 收稿日期:2014-05-11

随着全世界数字图像的数量以指数级的速度快速增长,基于内容的图像检索(content based image retrieval,CBIR)技术已成为图像应用领域的热点之一。当前的CBIR可分为三个层次:基于原始像素点的检索,基于特征的检索和基于语义的检索。其中,基于语义的检索需要大量的机器学习,复杂度高。此外,随着彩色摄像器材颜色精度的增强和各种显示媒体技术的发展,彩色图像早已取代灰色图像成为图像应用的主流,彩色图像检索技术也因此得到了更广泛的关注。彩色图像比灰度图像多出两维的描述数据,直接用三维数据计算图像特征会多出两倍的开销,这对需要处理大量数据的图像检索得不偿失。目前,彩色图像特征检索方法的研究大多侧重考虑全局特征方法,如颜色特征[1]、纹理特征[2]和形状特征[3],但这类方法无法体现感兴趣区域的特征。近几年兴起的局部特征能有效检测显著对象角点,代表性的方法有尺度特征转换(scale invariant feature transform,SIFT)[4]和ORB[5]。同时,出现了一些融合多种特征的检索方法[6]。

图像的多样性和图像检索的高复杂性,决定了针对某一领域的专业化垂直搜索将是未来图像检索的发展方向。本文针对具有视觉显著对象的彩色图像进行研究,提出了一种融合多特征的检索方法。显著对象是指人眼在观察图像时注意力集中在某一个或多个对象区域,其显著性体现为对象具有唯一性和完整性,且对象与周围区域存在十分明显的差异。

本文在研究基于光谱能量结构模型的彩色不变信息的基础上,将光谱能量结构模型中推导的彩色不变信息用于提取前景对象轮廓Freeman码[7]和对象局部特征点,从而得到一种新的图像综合特征方法,称之为Freeman码与ORB特征综合法(color invariants to Freeman and ORB,CIFO)。

1 颜色不变信息颜色是计算机视觉中一个重要且有效的特征,但颜色特征鲁棒性不好,容易受到场景光照的影响,局限了其应用。许多学者对彩色不变量信息进行研究,提出了相应的不变关系[8, 9, 10],试图找到独立于拍摄设备的不变性,但实际应用效果不尽如人意。文献[11]提出了基于光谱能量结构模型的彩色不变信息,推导出了与设备相关的彩色不变量信息。本文将这些不变量作为数据源进行图像特征提取,从而获取与光照、方位无关的特征量信息。

1.1 单一光线下的颜色不变量信息

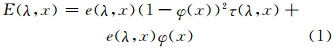

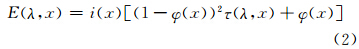

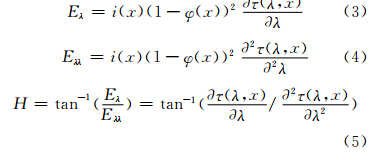

为分析可见光谱中的不变关系,从光照的物理模型进行分析,可参考Kubelka-Munk理论模型[12]:

其中,E(λ,x)为在某一瞬间(曝光时间)内观测到的光谱能量总和;x为图像平面中的位置;λ表示入射光的波长;e(λ,x)表示x处的入射光能量;φ(x)∈[0, 1]为物体在x处的菲涅耳镜面反射系数;τ(λ,x)表示材质的光谱反射率,即物体反射不同波段光线的能力。

在照射光线单一的情况下,e(λ,x)的波长λ为常数,那么,可以使用一个只与空间位置相关而与波长无关的量i(x)替代e(λ,x),式(1)可变换成:

对波长λ求一阶导数和二阶导数,得到:

H与x处的菲涅耳反射系数、入射光强度无关,只和物体本身的材质有关。H为颜色不变量的一种表述,与观察位置、表面朝向、光强大小、反射系数均无关。

将H作为基础彩色不变量可导出其他不变量信息,其中,H对x的微分可被用来提取同材质本身相关而与位置、照明强度和方向等无关的彩色边界:

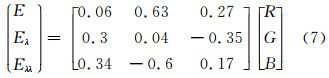

为了得到常用的RGB颜色空间与颜色不变量信息之间的关系,可根据实测的CIE1964XYZ标准与光学设备的参数,找到CIE1964标准与常用RGB彩色模型的变换关系[13],再建立高斯导数彩色模型与CIE标准的联系[14]。其中,λ0=520 nm,σλ=55 nm。

由式(5)~(7)可以求出彩色图像的颜色不变量和颜色边界。

1.2 复杂光线下的颜色不变信息根据式(2)建立的颜色不变模型是在入射光波长单一的情况下提取的,这无法满足复杂光线下的颜色不变信息的提取[15]。为了让复杂光线下的RGB颜色空间满足颜色不变模型,需要将RGB颜色空间进行规范化[16]:

式中,μR、μG和μB分别为彩色空间各通道值的分布均值;σR、σG和σB 分别为彩色空间各通道值的分布标准差。规范化的RGB颜色空间可代入式(7)进行颜色不变特征提取。

2 CIFO特征与相似性度量 2.1 CIFO组合特征方法由于通过式(5)、(6)可以提取到彩色图像的不变量和颜色边界,本文在此基础上提出了一种组合特征方法,即CIFO特征。CIFO特征包含了对象轮廓Freeman码和对象彩色ORB特征点。CIFO特征的提取方法见图 1,其中,前景对象的Freeman码代表了图像的全局特征,前景对象的ORB描述符则是局部特征,全局特征和局部特征的结合有利于提高匹配精度。

|

| 图 1 CIFO特征的提取方法 Fig. 1 Extracting CIFO Feature |

在计算机视觉中,形状是目标识别和检测的重要特征。对于商标和地标这一类具有显著对象的图像,对象的轮廓是形状特征最直接的表现。因此,基于轮廓信息进行形状特征描述是最直接有效的方法,而轮廓描述方法中最常用的是链码描述和傅里叶描述子。为实现匹配的快速性,本文采用了链码直方图的轮廓描述方法。轮廓Freeman码直方图的构建分为4个步骤:

1) 基于颜色边界的轮廓提取。 通过光谱不变模型导出的是颜色边缘信息,即不是闭合的目标轮廓线,无法进行循环链码描述。为此,本文在边界信息的基础上采用了一种基于边界搜索的轮廓提取方法[17],获得闭合的轮廓曲线。基于边界搜索的方法在处理具有显著对象的图像情况下,其提取轮廓的性能与传统的snake模型[18]相当,但其复杂度很低,复杂度可表示:

其中,L为图像灰度;N为像素数;Len为轮廓长度。本文将颜色边缘图像作为轮廓提取的输入。

2) 构建循环差分Freeman码。 轮廓最简单的表示方法是Freeman提出的链码方法。该链码沿着数字曲线或边界像素以8邻接的方式移动,每一个移动方向由数字集 {i,i=0,1,2,…,7}进行编码,表示与X轴正向的(π×i)/4夹角。 但是,Freeman的8向链码不具有旋转不变性。因此,可将链码转换成循环差分链码,以实现旋转不变性。循环差分链码是用相邻链码的差分值代替原来码字,对于向链码需要按模8进行取值。循环差分链码是关于旋转不变的边界描述方法。

3) Freeman码直方图。 在循环差分链码的基础上进一步构建差分链码直方图,计算公式为:

其中,nk是一个链码中链码值k的数目;n是该链码的总节点数。这样,得到了一个归一化的直方图描述子。

通过上述方法构建的循环差分链码直方图的特点为:计算量小;能提取到彩色轮廓;尺度不变性;旋转不变性。

2.1.2 基于显著对象的彩色ORB描述局部特征点的提取与匹配已广泛应用于计算机视觉领域。SIFT算法是公认的鲁棒性较好的特征点方法,但由于其高维度和高计算成本的特点,难以适用于需要处理大量图像数据的图像检索。最新的ORB算法采用了二进制字符串方法,存储和匹配速度得到了较大提高。但是,ORB只能处理灰度图像,且在复杂光照条件下鲁棒性不佳。因此,本文在颜色不变特征和ORB基础上提出了一种针对彩色显著对象的特征点提取方法,步骤如下:

1) 颜色不变量。按照式(5)、(8)提取颜色不变量 H,H 可替代原图像灰度数据进行特征点提取,以排除光照、角度等干扰因素。

2) 前景对象的特征点。本文的检索方法是针对前景对象的,关注的兴趣区域也就限于目标本身,因此特征点提取只在目标轮廓线内部进行。

3) 特征点描述。用ORB描述符算法对提取的特征点进行描述,得到的描述符是二进制比特串。描述符只针对前景对象,排除了背景环境的干扰,因此匹配时的计算复杂度也会相应减少。

由于颜色不变量只反映物体本身的材质特性,与光照、方位无关,在其基础上提取的特征点更能体现物体本身的材质信息,而对复杂光照、角度方位具有很好的鲁棒性。此外,ORB特征点的提取只限于对象轮廓线的内部,排除了背景环境的干扰。因此,这种基于对象的彩色ORB描述方法不仅比传统的ORB算法能检测到更全面的局部信息,而且鲁棒性更好。

2.2 相似性度量

在图像检索中,特征描述符的匹配决定了系统检索速度。图像检索通常在检索前就提取出全部图库中图像的特征描述子并进行存储,在检索时只需将描述子进行快速匹配查找。

本文在颜色不变量的基础上结合了轮廓Freeman码直方图和彩色ORB特征点两种特征进行匹配检索,其度量方法也需要综合两种特征。

2.2.1 Freeman码直方图图像 x的轮廓xi与图像y的轮廓yi 相似性度量采用Manhattan距离公式:

式中,D(x,y)越大,两个轮廓差异越大。实验中发现,D(x,y)≤0.2时,两个轮廓相似度较高,可判断为相似轮廓。

2.2.2 ORB特征匹配特征点匹配就是找出相应两幅图像中特征点的相似度。ORB特征点的描述子是一个长度为256的二进制比特串,描述符之间的距离可以用汉明码进行异或操作,以提高计算效率。

匹配成功的特征点对的相对数量越大,两张图像相似度越高。样本图像x与图像库中图像y的相似度可采用式(12)计算:

其中,n(xi=yi)为图像x与图像y成功匹配的特征点对的数量;n(xi)为样本图像x的特征点数量。实验中把E(x,y)≥0.15的两幅图像判断为相似的两幅图像。

2.2.3 CIFO相似性度量本文结合了轮廓直方图和ORB特征点来计算图像间的相似性,具体可采用式(13)进行度量。

其中,β1和β2 分别为轮廓Freeman直方图和ORB特征点的权重因子。在对Corel库图像的实验中发现,β1和β2 分别取0.22和0.78时,能够查询出较多的同类图像。

3 实验与分析

实验采用OpenCV2.3.1视觉库,在VS2010平台上编程实现。实验的硬件平台为2.2 GHz Intel Pentium Dual,2 GB 内存PC。

3.1 特征性能分析1) 轮廓特征。由于在本文算法中,轮廓特征是粗匹配特征,要求提取的轮廓特征数量小,且为主要的“兴趣”对象的轮廓。图 2(a)为Corel图像库中Elephant类的图像,图 2(b)为提取的颜色边界图像,图 2(c)为应用本文方法提取的轮廓特征二值图像。通过图 2可以发现,本文方法能够提取到主要“兴趣”对象的轮廓,且轮廓为闭合曲线,可有效构建循环Freeman码。

|

| 图 2 颜色不变量实验图像 Fig. 2 Test Image of Color Invariants |

2) 特征点性能分析。图 3是传统ORB与彩色ORB算法的实验比较图。实验选用了两幅彩色图像,且两幅图像存在较明显的光照差异。图 3(a)是ORB算法匹配结果,3(b)是本文方法匹配结果。可以看出,由于彩色ORB是在颜色不变量的基础上提取的,对复杂光照颜色和角度具有更强的鲁棒性,与传统的ORB方法相比匹配准确率更高。

|

| 图 3 ORB与CORB匹配实验比较 Fig. 3 Comparation of Mathing Between ORB and CORB |

图 4是全景图匹配和基于显著对象匹配的实验图,实验图像是从Elephant类中选取的相似度较高的两张图像,视为相似目标的匹配。图 4(a)是采用全景图进行彩色ORB匹配实验,图 4(b)是基于显著对象的匹配。对比发现,全景图匹配时,背景中会存在匹配对,对匹配实验结果造成了一定干扰。

|

| 图 4 全景图与前景图的匹配实验 Fig. 4 Matching Test for Panorama and Object |

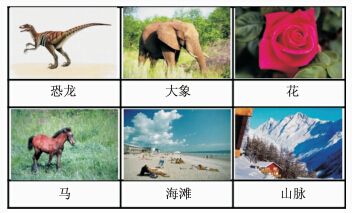

为验证本文提出的方法能有效检索具有显著对象的彩色图像,采用国际通用图像检索库Corel图像库进行测试。本文从Corel图像库中选取恐龙、大象、花、马、海滩、山脉6类进行实验,每一类图像是由同类目标的100张图像组成,其中,恐龙、大象、花、马具有较为理想的显著对象。图 5为实验的6类图像示例。

|

| 图 5 Corel库中的六类图像示例 Fig. 5 Selected Image from Corel |

|

| 图 6 平均查全率和查准率统计图 Fig. 6 Statistical Chart of the Average of Recall and Precision |

检索性能评估的通用准则是有效性、效率和灵活性,分别代表查找与目标相似图像的成功率、检索的速度及对不同应用的灵活性。由于效率和灵活性受硬件等多因素影响较大,目前还没有很好的统一评价机制,因此,当前对CBIR的评价通常是检索的有效性。

为了充分比较本文检索方法性能,将文献[1]中的传统颜色直方图方法、文献[2]中的Gabor纹理方法、文献[6]中的CEDD方法同本文方法进行对比实验。三种对比方法是目前基于特征检索的经典方法,且在Lucene平台下的LIRe库中都已经实现,具有公开性和代表性。实验时在选取的6组图像中随机各取10张图像作为待检索图像进行检索。对每一类的10次返回的前30张图片结果计算查准率和查全率的平均值,图 6(a)为查准率平均值的柱状图,图 6(b)为查全率平均值的柱状图。

从查全率和查准率的对比分析可以看出,4种方法在最简单的恐龙类检索时性能都表现较好,但在其他5类图像检索中颜色直方图和Gabor纹理两种单一特征的方法效果较差;CEDD算法的综合性能较好,但对于具有显著对象的恐龙、大象、花、马4类图像,本文方法较之有明显优势。

4 结 语由分析和实验可以看出,在颜色边界和颜色不变量基础上构建的轮廓特征和局部特征点对复杂光照具有很好的鲁棒性。结合了对象轮廓直方图和前景对象的ORB描述符的特征方法,在匹配时比直接全局ORB匹配的精度更高。

从理论上,本文提出的方法既包含了整体颜色及轮廓结构信息,又考虑了局部区域特征,且描述子为直方图和二进制码串,不仅存储空间小,匹配检索的速度也会更快。本文方法是目前针对具有显著对象的彩色图像的理想检索方法,尤其适用于商标、地标类图像的查询检索。

| [1] | Swain M J, Ballard D H. Color Indexing[J]. International Journal of Computer Vision, 1991, 7(1): 11-32 |

| [2] | Zhang Dengsheng, Aylwin W, Indrawan M, et al. Content-based Image Retrieval Using Gabor Texture Features[C]. IEEE Pacific Rim Conference on Multimedia, Sydney, Australia, 2000 |

| [3] | Shuai Yun, Ai Tinghua, Shuai Haiyan, et al. Polygonal Inquiry Based on Shape Template Matching[J]. Geomatics and Information Science of Wuhan University, 2008, 33(12): 1 267-1 270(帅赟, 艾廷华, 帅海燕, 等. 基于形状模板匹配的多边形查询[J]. 武汉大学学报·信息科学版, 2008, 33(12): 1 267-1 270) |

| [4] | Lowe D G. Distinctive Image Features from Scale-invariant Keypoints[J]. International Journal of Computer Vision, 2004, 60(2):91-110 |

| [5] | Rublee E, Rabaud V, Konolige K, et al. ORB: An Efficient Alternative to SIFT or SURF[C]. IEEE International Conference on Computer Vision, Barcelona, 2012 |

| [6] | Chatzichristofis S A, Boutalis Y S. CEDD: Color and Edge Directivity Descriptor: A Compact Descriptor for Image Indexing and Retrieval[C]. International Conference on Computer Vison Systems, Greece, 2008 |

| [7] | Freeman H. On the Encoding of Arbitrary Geometric Configurations[J]. Electronics and Computers, 1961, 10(2): 260-268 |

| [8] | Gevers T, Smeulders A W M. Color Based Object Recognition[J]. Pattern Recognition, 1999, 32(3): 453-464 |

| [9] | Slater D, Healey G. The Illumination-Invariant Recognition of 3D Objects Using Color Invariants[J]. Pattern Analysis and Machine Intelligence, 1996, 18(2): 206-210 |

| [10] | Funt B V, Fiulayson G D. Color Constant Indexing[J]. Pattern Analysis and Machine Intelligence, 1995, 17(5): 522-529 |

| [11] | Geusebroek J M, van den Boomgaard R, Alllold W M. Smeulders, Color Invariance[J]. Pattern Analysis and Machine Intelligence, 2001, 23(12): 1 338-1 350 |

| [12] | Geusebroek J M. Color and Geometrical Structure in Images[D]. Amsterdam:University of Amsterdam, 2000 |

| [13] | Comaniciu D, Meer P. Robust Analysis of Feature Spaces: Color Image Segmentation[C]. Computer Vision and Pattern Recognition, San Juan, 1997 |

| [14] | Geusebroek J M, van den Boomgaard R, Smeulders A W M, et al. Color and Scale: The Spatial Structure of Color Images[M]. Berlin, Heidelberg:Springer, 2000 |

| [15] | Wu Panchao, Wang Zongyi, Liu Tao. Color SIFT Matching Algorithm Under Changing Complex Illumination[J]. Journal of Huazhong University of Science and Technology(Nature Science), 2011, 39(5):100-104(吴攀超,王宗义,刘涛.复杂光照变化条件下的彩色SIFT匹配算法[J]. 华中科技大学学报(自然科学版) , 2011, 39(5): 100-104 |

| [16] | van de Sande K E A, Snoek C G M. Evaluation of Color Descriptors for Object and Scene Recognition[C]. The Computer Vision and Pattern Recognition Conference, New York, 2008 |

| [17] | Lu Chengen, Zhu Guangxi, Sun Jun. An Enclosed Contour Extracting Method Based on EdgeTracking[C]. The 14th National Conference on Image and Graphics, Fujian, China, 2008(陆承恩, 朱光喜, 孙俊. 基于边界搜索的图像闭合轮廓提取算法[C].第十四届全国图象图形学学术会议, 福建, 2008) |

| [18] | Kass M, Writkin A, Terzopoulos D. Snakes: Active Contour Models[J]. International Journal of Computer Vision, 1987, 1(4): 321-331 |

2015, Vol. 40

2015, Vol. 40